Die Meldung eines neuen «KI-Assistenten für die Bundesparlamentier:innen» von letzter Woche war eine positive Überraschung: Der KI-Assistent soll auf einem Open-Source-Sprachmodell basieren, das auf die Bedürfnisse der Schweizer Legislative zugeschnitten und mit den relevanten Datenbanken des Bundes verbunden ist.

Natürlich, noch ist hierbei nichts entschieden. Die Motion der Sicherheitspolitischen Kommission muss zuerst in beiden Räten noch beraten werden.

Dieser KI-Assistent soll bei der Erstellung von Vorstössen helfen und beispielsweise vergleichbare Texte in der Datenbank abklappern. Eine sehr gute Idee, denn ich habe mich schon oft gefragt, wie viel Redundanz (und Zeitaufwand, somit auch Steuergelder) vermieden werden kann, wenn Parlamentarier:innen einfach etwas besser recherchieren würden – zum Beispiel zum Thema KI-Regulierung. Aber nun gut, ein politischer Vorstoss dient auch der politischen Profilierung, auch wenn der Fraktionskollege wortgetreu dasselbe Verbot oder denselben Kredit fordert.

(Weitere interessante KI-Projekte gemäss des Kompetenzzentrums CNAI in diesem Bereich sind übrigens der Chatbot mit dem Projektnamen «KI-Chatbot ParlData«. Mit ihm sollen statistische Daten des Parlaments auf Grundlage der Parlamentsdatenbank in allen drei Amtssprachen abgefragt werden können – ebenso ein KI-Algorithmus, der die automatische thematische Zuteilung der politischen Vorstösse an die Bundesverwaltung übernimmt. Also hierbei geht es um die Beantwortung der Frage: Welches Departement muss jenes Postulat beantworten?)

Natürlich verbleiben dann noch die Fragen zum Modell, wie mein Kollege Reto Vogt treffend formuliert:

Womit wird dieses genau trainiert, mit welchem Bias?

Wenn die SVP oder die SP mehr Anträge formulieren, wird der Parteijargon und Bias dann auch vom Modell übernommen?

Wie steht es um Polemiken, die politischen Vorstössen inhärent sind? Werden diese im Training „ausgemerzt“?

Doch eine weitere entscheidende Frage haben etliche Medien noch nicht gestellt:

Nämlich: Wie haben das die Parlamentarierinnen und Parlamentarier eigentlich bisher gehandhabt?

Tippen Nationalrätinnen ihre Vorstösse-Entwürfe in KI-Systeme und laden – im schlimmsten Fall – sogar Kommissionsprotokolle auf ChatGPT oder Gemini hoch? Schreiben Ständeräte, die zur Geheimhaltung wegen einer laufenden Untersuchung verpflichtet sind, politische Informationen zu einem Geschäft ein? Landen diese auf amerikanischen Servern?

Denn – so habe ich von verschiedenen Quellen im Bundeshaus vernommen – hier herrscht von links bis rechts vor allem eines: Anarchie und Jekami. Will heissen: National- und Ständerät:innen tippen sorglos ihre Sitzungsprotokolle ein – für Zusammenfassungen.

Und die Sicherheitspolitische Kommission schreibt sogar in der Begründung ihrer Motion:

Mehrere Ratsmitglieder nutzen bereits KI-Chatbots wie ChatGPT oder Claude, um Texte zu analysieren, Vorstösse auszuarbeiten oder Dokumente zusammenzufassen. Diese Tools sind zwar nützlich, doch stellen sich bei ihrer Verwendung die folgenden drei Hauptherausforderungen:

- Es besteht die Gefahr, dass sensible Informationen den sicheren Rahmen des Bundes verlassen und öffentlich werden.

- Es besteht die Gefahr, dass die Antworten von Tools mit einem «Bias», einer Priorisierung oder einer Logik, die den Schweizer Interessen zuwiderlaufen, beeinflusst werden.

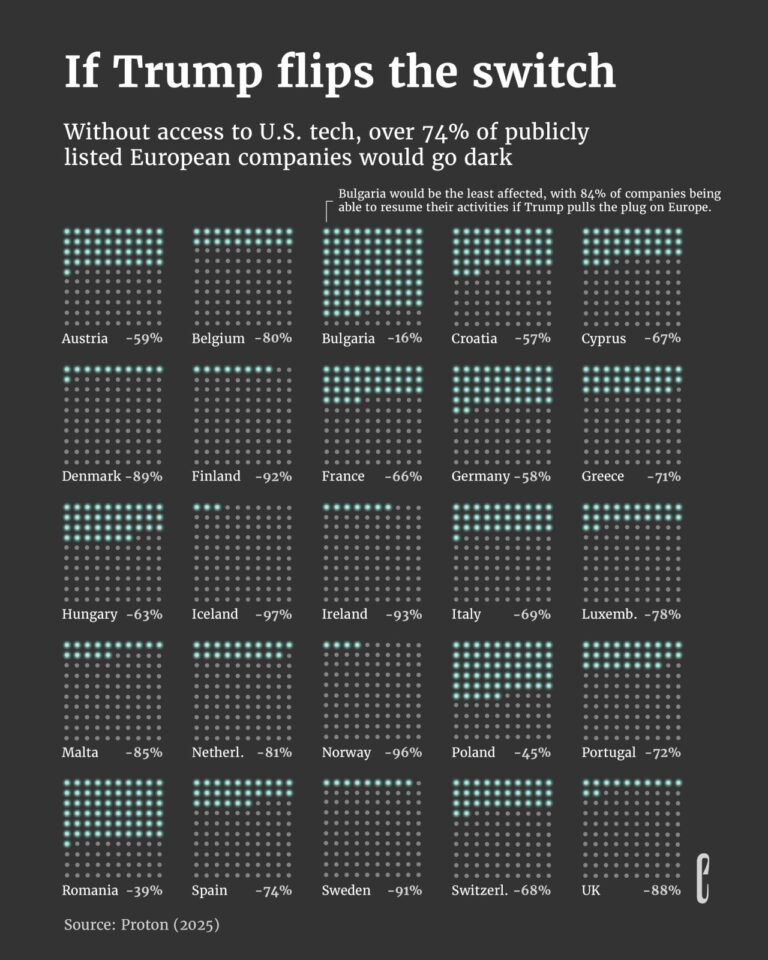

- Es besteht eine strukturelle Abhängigkeit von Technologien, die ausserhalb des institutionellen und rechtlichen Rahmens der Schweiz entwickelt wurden.

Eine Nachfrage bei der Sprecherin der Parlamentsdienste und eine Nachfrage bei den Fraktionen bestätigt dies. So schrieb ein Fraktionspräsident:

Wir machen unseren Fraktionsmitgliedern hierzu keine Vorgaben, da die Mitglieder der Bundesversammlung in der Ausübung ihres Mandates frei sind.

Dabei hat die Nutzung von Gemini, Perplexity und ChatGPT nichts mit Freiheit, sondern mit Verantwortung und Sicherheitsrisikobewusstsein zu tun.

Dass es hierzu weder von den Fraktionen noch von den Parlamentsdiensten Vorgaben gibt – etwa, ob und inwiefern allfällige Amtsgeheimnisse in KI-Systeme eingetippt werden dürfen –, zeigt die unterentwickelte Digitalkompetenz dieses Bundesparlaments. Was früher oder später zu einem Sicherheitsrisiko werden kann. Wie welche Daten von Nutzer:innen einfliessen und wie man 1x eingeflossenes fehlerhaftes oder komprimittierbares Trainingsmaterial fast nicht mehr rausbekommt aus den Sprachmodellen, hat mein Kollege Marcel in zwei aufschlussreichen DNIP-Artikeln aufgeschrieben.

Es ist also höchste Zeit, geeignete KI-Instrumente zu entwickeln, die leistungsfähig sind, dem Schweizer Gerichtsstand unterstehen und auf Schweizer Infrastruktur laufen und über die man auch selber ein wenig Qualitätskontrolle anwenden kann– damit kein Datenabfluss erfolgt.

Und die damit auch die Schweiz etwas weniger kompromittierbar machen.